Het “paradox van kunstmatige intelligentie” vormt een groeiende uitdaging voor bedrijfsleiders: miljoenen investeren in krachtige GPU’s, alleen om ze inactief te zien wachten op gegevens. Terwijl bedrijven overstappen van pilotprojecten naar productie, is de echte bottleneck niet de verwerking, maar de verborgen kosten van een inefficiënt netwerk. In schaalbare architecturen moeten tienduizenden GPU’s synchroniseren om een enkele trainingsiteratie te voltooien. Wanneer het netwerk niet kan voldoen aan de hectische eisen van moderne AI-training, raken de GPU’s verstopt en nemen de job completion times (JCT) toe. We hebben samengewerkt met AMD om een end-to-end AI-infrastructuur te leveren die deze bottlenekken elimineert en het netwerk transformeert tot een krachtige motor voor innovatie.

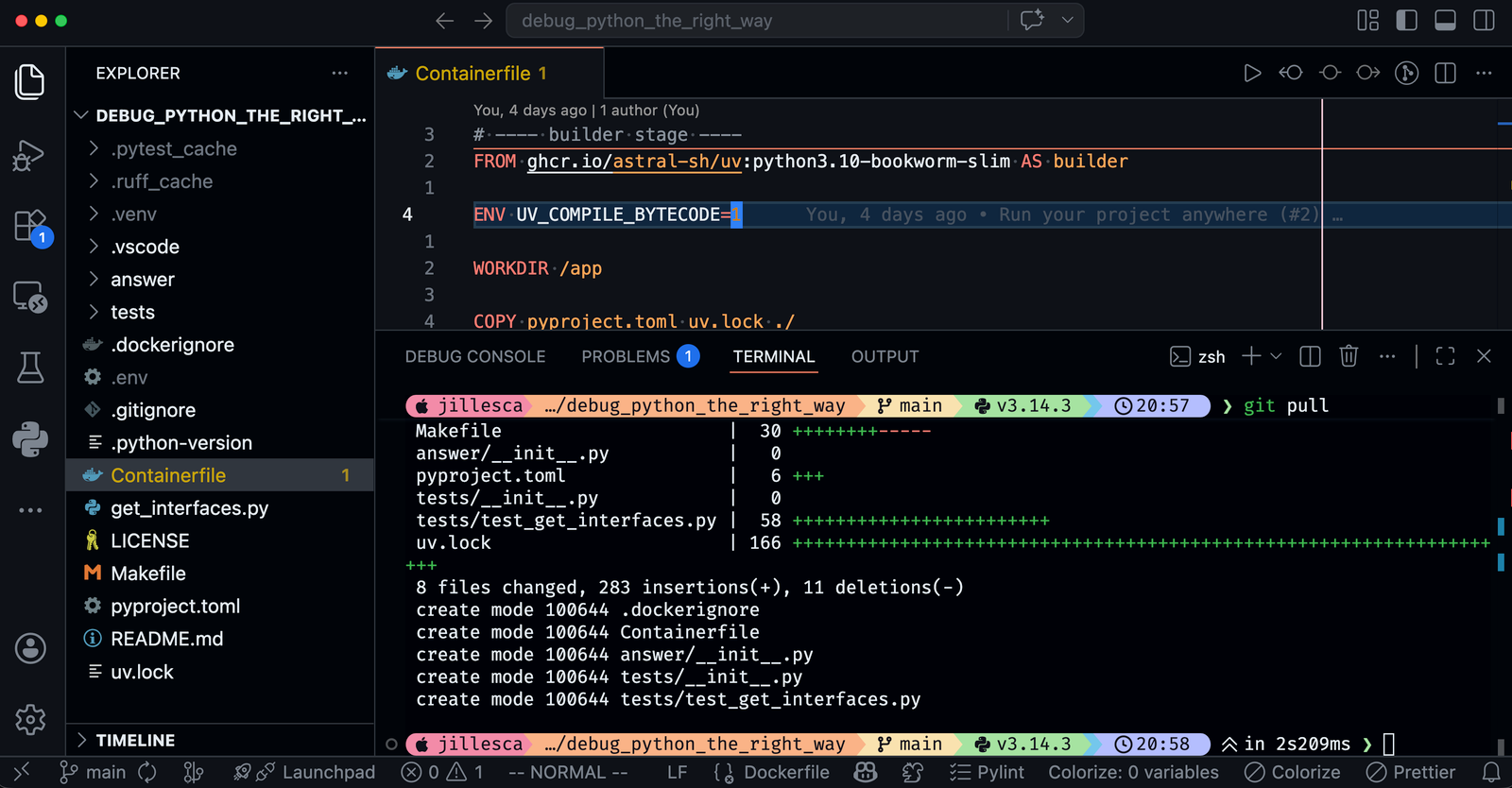

Fabric als basis: het AI-prestatieproject van Cisco en AMD

Naarmate AI-workloads zich uitbreiden over gedistribueerde clusters, moet het netwerk lineair schalen om pakketverlies en retransmissies te voorkomen. Deze prestaties kunnen alleen worden geverifieerd via rigoureus en echt benchmarking. Cisco geeft prioriteit aan systemische en deterministische prestaties die verder gaan dan de specificaties van individuele componenten.

Onze referentiearchitectuur omvat AMD Instinct™ MI300X GPU’s, AMD Pensando™ Pollara 400 NIC’s, Cisco Silicon One G200-gebaseerde N9364E-SG2-switches en Cisco 800G OSFP-optica. De implementatie is slechts de helft van de uitdaging; het op grote schaal opereren is de andere helft. Cisco Nexus Dashboard biedt de gedetailleerde real-time zichtbaarheid die nodig is voor operationele activiteiten van dag 0 tot dag N.

Door deze technologieën te combineren, minimaliseren we de JCT en maximaliseren we het GPU-gebruik, waardoor de AI-infrastructuur veilig, compliant en continu geoptimaliseerd blijft.

Benchmarking van de architectuur

We hebben twee Clos-topologieën (2×2 en 4×2) vergeleken met Cisco N9364E-SG2-switches (elk met een throughput van 51,2 Tbps en 64 poorten van 800 GbE), 128 AMD Instinct™ MI300X GPU’s (16 servers x 8 GPU), 128 AMD Pensando™ Pollara 400 AI NIC’s (16 servers x 8 NIC) en AMD ROCm™ 6.3/7.0.3-software-ecosysteem.

Topologie 2×2 Clos

Dit project vult elk bladswitch volledig in, waardoor de switch onder hoge congestie wordt gebracht om de veerkracht van het netwerk te testen:

– 2x leaf en 2x spine switches (4x Cisco N9364E-SG2).

– 8 servers (8 AMD Instinct™ MI300X GPU’s) verbonden met elk bladswitch.

– 8 AMD Pensando™ Pollara 400G NIC’s per server.

– Switch-side: Cisco OSFP 800G DR8-optica.

Topologie 4×2 Clos

Dit project richt zich op de effectiviteit van geavanceerde load-balancingtechnieken voor een efficiënte verdeling van de belasting tijdens synchrone bursts in de GPU scale-out-structuur:

– 4x leaf en 2x spine switches (6x Cisco N9364E-SG2).

– 4 servers (8 AMD Instinct™ MI300X GPU’s) verbonden met elk bladswitch.

– 8 AMD Pensando™ Pollara 400G NIC’s per server.

– Switch-side: Cisco OSFP 800G DR8-optica.

Benchmarkingtools

We hebben de schaalbare stoffenprestaties gemeten met behulp van een uitgebreide set tools, waaronder:

– IBPerf meet RDMA-prestaties op een schaalbare infrastructuur in verschillende drukke scenario’s. We hebben deze tool gebruikt om de prestaties te testen tussen GPU’s verbonden op een enkel blad en over de rug van het blad.

– MLPerf is een industriestandaard benchmark die wordt gebruikt om de feitelijke prestaties van workloads te meten. De prestatieoutput vertaalt zich in ROI voor volledig gevalideerde projecten van Cisco en AMD.

Resultaten van het benchmarken van de netwerkstofprestaties

We hebben de prestaties van de schaalbare stof geëvalueerd met uitgebreide tests en standaard KPI’s.

– Single-hop IBPerf-test evalueert de prestaties binnen een gelokaliseerd stofdomein, meestal binnen een enkele bladswitch. Deze test meet het RDMA-sessiethroughput tussen twee GPU’s verbonden via een Cisco N9364E-SG2 bladswitch. De resultaten leggen de P01 (1e percentiel) en P99 (99e percentiel) bandbreedte vast, terwijl alle sessies tegelijk actief zijn. De P01-bandbreedte vertegenwoordigt de langzaamste sessiebandbreedte, een essentiële metriek voor synchrone AI/ML-workloadprestaties, terwijl P99 de snelste sessiebandbreedte vertegenwoordigt. Een minimale delta tussen P01 en P99 en elke bandbreedte die dichter bij de linkbandbreedte ligt, toont de effectiviteit van de GPU-interconnectietechnologie aan.

In de 2×2 topologie behandelt elke bladswitch 32 bidirectionele sessies, waardoor de bladswitch effectief verzadigd raakt. De 4×2 topologie behandelt 16 bidirectionele sessies per blad. In beide topologieën en met variabele tellingen van queue pairs (QP) (4 QP en 32 QP), zijn de P01- en P99-bandbreedtes in beide topologieën en beide sets QP dichter bij elkaar, elk benaderend de 400 Gbps linkbandbreedte.

Deze prestaties laten zien dat de AMD Pensando™ Pollara NIC’s en Cisco N9364E-SG2-switches een zeer efficiënte oplossing bieden voor veeleisende workloads. De minimale delta tussen P01 en P99 op verschillende schalen en configuraties toont aan dat deze architectuur deterministische prestaties handhaaft, ongeacht de grootte van de cluster of de dichtheid van de queue pairs.

– Bidirectionele IBPerf-test evalueert het cross-fabric-verkeer dat meerdere niveaus doorkruist om de bidirectionele bandbreedte, de symmetrie van het pad, de load-balancing over de spine en de congestieverspreiding te meten. Deze test meet het RDMA-sessiethroughput tussen twee GPU’s verbonden via Cisco N9364E-SG2 leaf en spine switches. De resultaten tonen aan dat de P01- en P99-bandbreedtes met alle sessies actief gelijk zijn. In de 2×2 topologie zijn er 32 bidirectionele sessies per leaf, terwijl de 4×2 topologie 16 bidirectionele sessies per leaf heeft. Al deze sessies gaan over de spine. Het verkeer van elke sessie gaat over drie hops (leaf-spine-leaf) om het gehele stof te belasten. Deze test valideert de efficiëntie van het load-balancingalgoritme van de stof; elke verkeerspolarisatie zou leiden tot onderbenutting van sommige links, terwijl andere links verstopt zouden raken, wat uiteindelijk de RDMA-sessieprestaties zou verminderen. De tests werden uitgevoerd met 4 en 32 QP.

De resultaten tonen aan dat de P01- en P99-bandbreedtes vergelijkbaar zijn en elk dichter bij de 400 Gbps linkbandbreedte liggen, wat de prestaties weerspiegelt die werden waargenomen in de single-hop tests. Dit bevestigt dat de Cisco N9364E-SG2-switches en de AMD Pensando™ Pollara NIC’s een veerkrachtige en hoogwaardige GPU-interconnectietechnologie bieden die consistent deterministische prestaties onder stress kan handhaven.

– Congestietest IBPerf creëert hoog conflictscenario’s met een 31:1 communicatiemodel, waarbij 31 GPU’s communiceren met één enkele GPU. Het evalueert de code-opbouw, de effectiviteit van Explicit Congestion Notification (ECN), de DCQCN congestienotificatie reactiecurven, de wachttijd van de queue en de stofstabiliteit in AI-communicatiemodellen in het slechtst mogelijke geval. De incast-omstandigheden vertegenwoordigen enkele van de meest uitdagende scenario’s voor schaalbare AI-infrastructuur.

Deze test meet de P01- en P99-bandbreedtes onder incastomstandigheden, die zich voordoen tijdens collectieve communicatie zoals all-to-all. Als de hardware, het ontwerp en de optimalisatie van de schaalbare infrastructuur niet optimaal zijn, leidt dit tot aanzienlijke verslechtering van de JCT voor trainingsworkloads. Omdat het moeilijk is om alle sessies te synchroniseren zodat ze tegelijkertijd beginnen, gebruiken we de quantile-range-methode om de resultaten te analyseren. Het analyseert de bandbreedtesamples als gevolg van incastcongestie in plaats van alle bandbreedtesamples.

In deze test legt elke van de 128 GPU’s 31 RDMA-sessies vast met 31 andere GPU’s via het leaf-spine-stof, wat resulteert in 3.968 (31*128 = 3.968) gelijktijdig actieve sessies in de scale-out stof. De delta tussen P01 en P99 is zeer smal en elke bandbreedte ligt dicht bij de 400 Gbps linkbandbreedte, wat een solide bewijs is van het vermogen van de Cisco N9364E-SG2-switches om extreme congestieomstandigheden te beheren en een getuigenis is van het door Cisco en AMD gevalideerde ontwerp.

– MLPerf-training en inference benchmarking-tests stellen gestandaardiseerde metingen vast om de prestaties van training en inference workloads te evalueren. Door strikte richtlijnen toe te passen met betrekking tot modellen, datasets en toegestane optimalisaties, bieden deze benchmarks een gelijk speelveld voor een eerlijke vergelijking tussen concurrerende AI-infrastructuuroplossingen.

De MLPerf-tests van MLCommons zijn ontworpen om een gemeenschappelijke benchmarkmethodologie te bieden om applicatieniveau KPI’s te meten, die de belangrijkste prestatie-indicatoren voor eindgebruikers zijn. De resultaten van Llama 2 70B tonen duidelijke schaalvergroting van de throughput naarmate de configuratie zich uitbreidt van twee naar vier nodes. De training benchmarks leveren representatieve gegevens voor Llama 2 70B (op twee nodes) en Llama 3.1 8B (op acht nodes).

Deze resultaten vormen de basis voor onze belangrijkste claim: de door Cisco gevalideerde architectuur is niet alleen theoretisch geldig; het benchmarken laat zien dat het in staat is om de meest veeleisende AI inference en training workloads aan te kunnen.

Een real-world implementatie van de AI-oplossingsarchitectuur van Cisco en AMD

De Cisco-AMD samenwerking levert een echte impact, met name door grootschalige G42 AI-clusters aan te drijven. Deze end-to-end oplossing, die AMD GPU’s, Cisco UCS-servers, N9000 800G-switches en Nexus Dashboard integreert, biedt de veilige en schaalbare prestaties die nodig zijn voor toonaangevende AI-workloads.

“Met de schaalbaarheid van AI-workloads worden netwerkprestaties een kritische factor voor de efficiëntie van het cluster. De AMD Pensando™ Pollara 400 AI NIC, met zijn volledig programmeerbare en fault-tolerant ontwerp, biedt consistente prestaties voor horizontale schaalbaarheid van GPU-training. In samenwerking met Cisco N9000-switching brengen we Ethernet naar het volgende niveau, wat helpt om het GPU-gebruik te maximaliseren en de job completion te versnellen.” – Yousuf Khan, Vice President, Business Solutions and Network Technologies Group, AMD

Het operationaliseren van intelligentie: een nieuwe standaard voor schaalbare prestaties

In het tijdperk van grootschalige kunstmatige intelligentie vertegenwoordigt de infrastructuur van een organisatie haar grootste concurrentievoordeel of haar meest significante bottleneck. Wanneer de inzet betrekking heeft op mission-critical training, fine-tuning en inference, is een geïntegreerd en volledig gevalideerd ecosysteem essentieel. Cisco en AMD veranderen de vergelijking door een deterministische en high-performance structuur te bieden die uw netwerk transformeert tot een motor van innovatie.

Neem vandaag nog contact op met een Cisco AI-netwerkspecialist om een implementatie op maat te ontwerpen voor uw specifieke workloads.

BRON