Op dinsdag heeft Meta wereldwijd zijn nieuwe vocale nasynchronisatiefunctie gelanceerd. Deze functie maakt gebruik van generatieve technologie om uw stem te vertalen en optioneel lippen te synchroniseren. Mark Zuckerberg heeft een voorbeeld van deze functie bekeken tijdens META Connect 2024.

Bij de lancering zijn de vertalingen alleen beschikbaar van Engels naar Spaans (en vice versa). Het bedrijf heeft aangekondigd dat er later meer talen zullen volgen. In eerste instantie is de functie beperkt tot Facebook-makers met meer dan 1.000 volgers, maar iedereen met een openbaar Instagram-account kan er gebruik van maken.

De tool traint op basis van uw originele stem en genereert een vertaalde audiotrack om uw stemgeluid te behouden. De extra component die de lippen synchroniseert, zorgt ervoor dat de mond bewegingen synchroon lopen met de vertaalde spraak. De demo die vorig jaar door het bedrijf werd getoond was indrukwekkend.

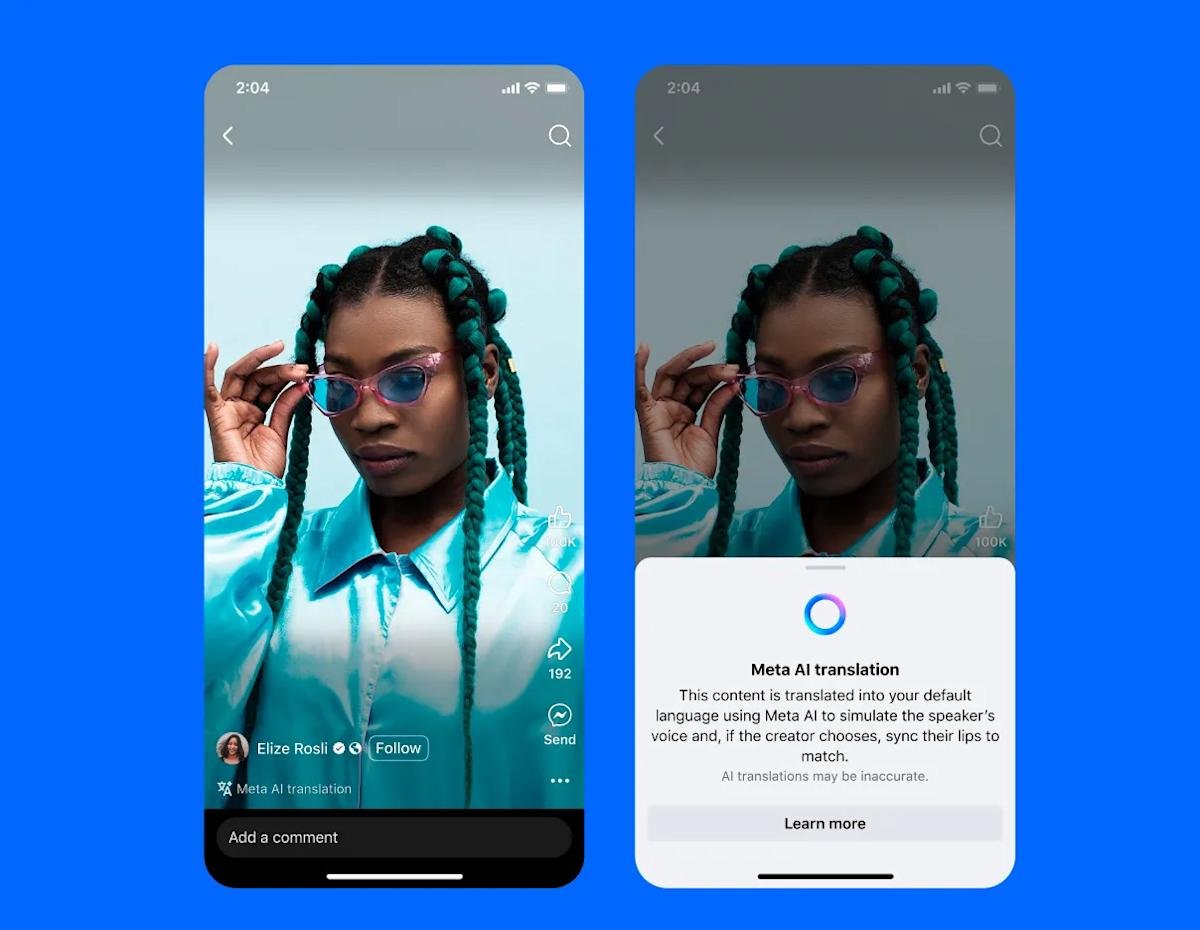

Om van de functie gebruik te maken, selecteert u “Vertaal uw stem met een bestemming naar” voordat u een opname publiceert. Hier kunt u ook kiezen om de lip synchronisatie toe te voegen en de door AI vertaalde versie voor publicatie bekijken. Kijkers zullen een melding zien dat het om een AI-vertaling gaat.

Meta adviseert dat de functie het beste werkt voor video’s met een gezicht erin. Het wordt aanbevolen om te voorkomen dat de mond bedekt is of dat er te veel achtergrondgeluid is. De functie werkt het beste met maximaal twee sprekers en het is raadzaam om duidelijk te spreken.

De functie wordt gepresenteerd als een manier voor makers om hun publiek uit te breiden buiten hun moedertaal. Meta heeft ook een taalprestatietracker toegevoegd, zodat makers kunnen zien hoe goed de vertalingen in verschillende talen worden ontvangen.

Vorig jaar lanceerde YouTube een vergelijkbare functie en Apple heeft ook live vertaaltools toegevoegd aan berichten, telefoons en FaceTime-apps in iOS 26.

BRON