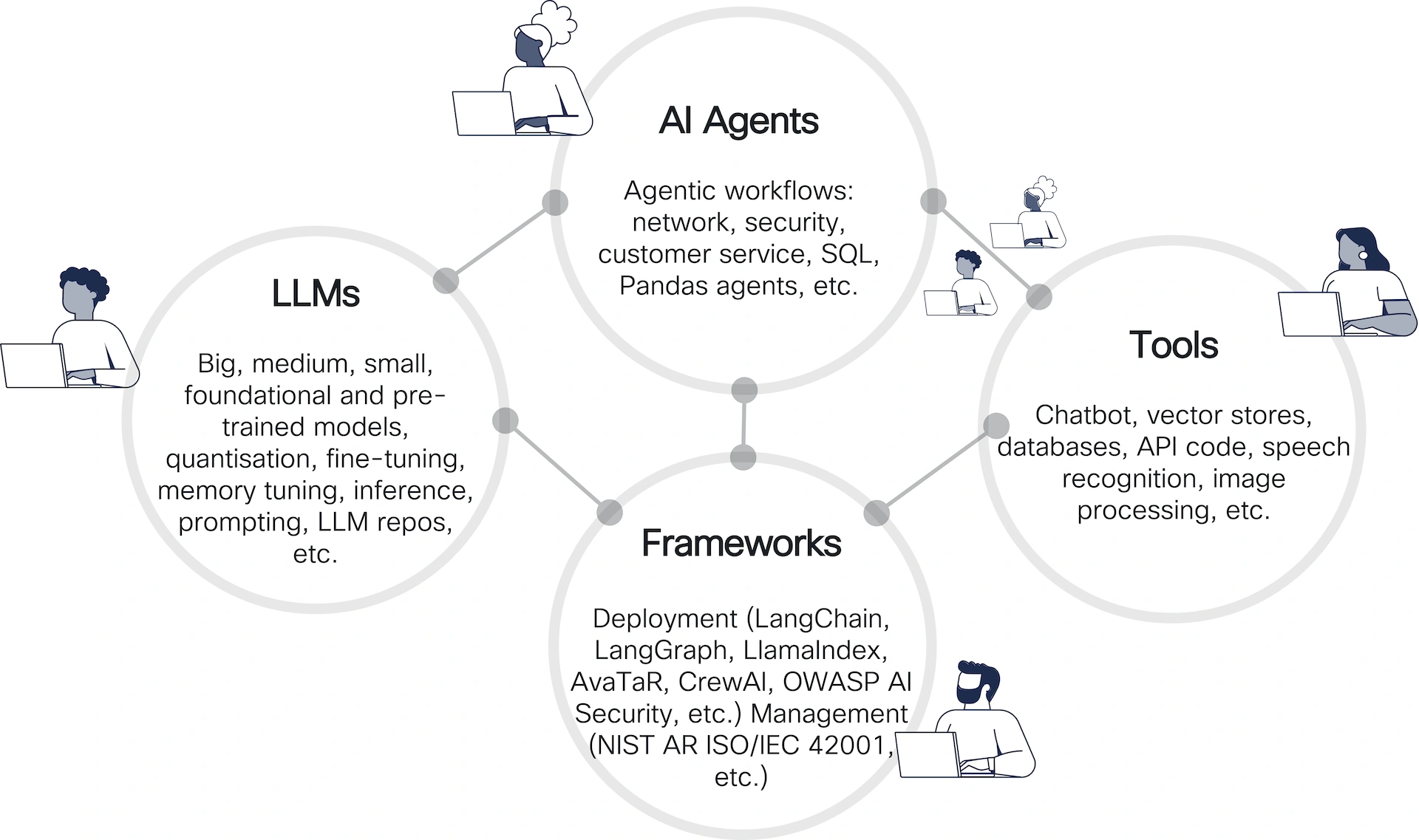

LLM, agenten, gereedschap en framework

Generatieve kunstmatige intelligentie (GenAI) zit vol met concepten en technische termen; Sommige termen die we vaak tegenkomen zijn grote modellen (LLM), kunstmatige intelligentie-agenten en agentsystemen. Hoewel gerelateerd, zijn verschillende (maar gerelateerde) doeleinden nodig binnen het AI-ecosysteem.

De LLM zijn de fundamentele taalmotoren die zijn ontworpen om tekst te verwerken en te genereren (en afbeeldingen in het geval van die met verschillende modellen), terwijl de agenten ernaar streven de vaardigheden van LLMS uit te breiden door tools en strategieën op te nemen om effectief complexe problemen aan te pakken.

Agenten die correct zijn ontworpen en gebouwd, kunnen zich aanpassen volgens feedback, hun plannen perfectioneren en de prestaties verbeteren om te proberen meer gecompliceerde taken te beheren. De agenten-agenten bieden bredere en meer onderling verbonden ecosystemen met meer agenten die samenwerken aan complexe doelstellingen.

De bovenstaande figuur schetst het ecosysteem van de agenten AI, die de relaties tussen vier hoofdcomponenten toont: LLMs, Agenten van AI, Kader en Hulpmiddelen. Hier is een pauze:

- LLMS (grote taalmodellen): Vertegenwoordigt modellen van verschillende maten en specialisaties (groot, medium, klein).

- Agenten van AI: Gebouwd boven de LLM, richten ze zich op werkstromen geleid door agenten. Ze maken gebruik van de vaardigheden van LLM’s door strategieën voor het oplossen van problemen toe te voegen voor verschillende doeleinden, zoals de automatisering van netwerkactiviteiten en veiligheidsprocessen (en vele anderen!).

- Kader: Distributie- en managementondersteuning bieden voor AI-toepassingen. Deze schilderijen vullen de kloof tussen LLM en operationele omgevingen op door bibliotheken te bieden die de ontwikkeling van agentsystemen mogelijk maken.

- De genoemde hefschilderijen zijn onder meer: Langchain, Langgraph, LlamaINDEX, Avatar, Crewai en Openai Swarm.

- De managementschilderingen houden zich aan normen zoals NIST AR ISO/IEC 42001.

- Hulpmiddelen: Schakel interactie in met kunstmatige intelligentiesystemen en breidt hun vaardigheden uit. De tools zijn cruciaal voor de levering van kunstmatige intelligentie-oplossingen voor gebruikers. Voorbeelden van tools zijn:

- Chatbot

- Vector voor gegevensindexering

- API -database en integratie

- Vocale herkenning en hulpprogramma voor beeldverwerking

AI voor het rode team

De volgende werkstroom benadrukt hoe IA de analyse, generatie, tests en rapportage van exploit kan automatiseren. Het is met name relevant in de penetratietests en in de ethische hackscenario’s waarin een identificatie en validatie van snelle kwetsbaarheden cruciaal zijn. De workflow is iteratief en gebruikt feedback om zijn acties te perfectioneren en te verbeteren.

Dit illustreert een Workflow voor computerbeveiliging Voor de geautomatiseerde exploitatie van kwetsbaarheid door AI. Het breekt het proces in vier verschillende fasen:

1. Analyseren

- Actie: De IA analyseert de verstrekte code en de uitvoeringsomgeving

- Objectief: Identificeert potentiële kwetsbaarheid en meerdere exploitatiemogelijkheden

- Ingang: De gebruiker biedt de code (op een “nul-shot” manier, wat betekent dat er geen specifieke informatie of training voor activiteit vereist is) en details over de runtime-omgeving

2. Exploiteren

- Actie: Kunstmatige intelligentie genereert potentiële exploitcode en verifieert verschillende varianten om de geïdentificeerde kwetsbaarheden te benutten.

- Objectief: Voer de exploitcode uit op het bestemmingssysteem.

- Proces: De AI-agent kan meerdere versies van de exploit genereren voor elke kwetsbaarheid. Elke versie wordt getest om de effectiviteit ervan te bepalen.

3. Bevestig

- Actie: De IA verifieert of de poging van exploit succesvol is geweest.

- Objectief: Zorg ervoor dat de exploit werkt en bepaalt de impact ervan.

- Proces: Evalueer de respons van het doelsysteem. Herhaal het proces indien nodig, herhalen tot het succes of uitputting van potentiële exploits. Houd vast aan welke benaderingen ze werkten of faalden.

4. Heden aanwezig

- Actie: De IA presenteert de resultaten van het uitbuitingsproces.

- Objectief: Bied de gebruiker duidelijke en onmogelijke inzichten.

- Productie: Details van de gebruikte exploit. Resultaten van de poging om te exploiteren. Overzicht van wat er tijdens het proces is gebeurd.

De agent (Smith!)

We codificeerden de agent met behulp van Langgraph, een raamwerk voor de constructie van werkstromen en toepassingen op basis van kunstmatige intelligentie.

De bovenstaande figuur illustreert een workflow voor de constructie van kunstmatige intelligentie-agenten die Langgraph gebruiken. Het onderstreept de behoefte aan cyclische stromen en voorwaardelijke logica, waardoor het flexibeler is dan de lineaire schilderijen op basis van ketens.

Belangrijkste elementen:

- Werkstroomstappen:

- Kwetsbaarheidsdation:Identificeert kwetsbaarheid als uitgangspunt

- GenerateExploitCode: Maak een potentiële exploitcode.

- Executecode:Voer de gegenereerde exploit uit.

- CheckkexecusionResuret:Controleer of de uitvoering succesvol is geweest.

- Analyreportresults:Analyseer de resultaten en genereert een uiteindelijke relatie.

- Cyclische stromen:

- Met de cycli kan de workflow terugkeren naar de vorige passages (bijvoorbeeld de exploitcode regenereren en opnieuw vinden) totdat aan een voorwaarde is voldaan (zoals het succes).

- Gemarkeerd als een cruciale functie voor het onderhoud van staatsacties en raffinage.

- Logica op basis van voorwaarde:

- Beslissingen in verschillende fasen zijn afhankelijk van specifieke omstandigheden, waardoor meer dynamische en reactieve werkstromen mogelijk zijn.

- Domein:

- Het framework is ontworpen om werkstromen van complexe agenten te creëren (bijvoorbeeld voor veiligheidstests), die iteratieve lussen en aanpassingsvermogen vereisen.

De testomgeving

De volgende figuur beschrijft een bestandtestomgeving Ontworpen om een kwetsbare applicatie voor veiligheidstests te simuleren, met name voor de Red Team-oefeningen. Opmerking De volledige installatie wordt uitgevoerd in een container-sandbox.

Belangrijk: Alle gegevens en informatie die in deze omgeving worden gebruikt, zijn volledig denkbeeldig en vertegenwoordigen geen echte of gevoelige informatie.

- Sollicitatie:

- Een Fles webtoepassing met twee eindpuntbijen.

- Deze eindpunten herstellen de opnames van patiënten die zijn opgeslagen in een SQLite-database.

- Kwetsbaarheid:

- Ten minste een van de eindpunten wordt expliciet kwetsbaar verklaard voor Injectieaanvallen (Waarschijnlijk SQL-injectie).

- Dit biedt een realistisch doel om het vermogen te testen om exploitatie te genereren.

- Componenten:

- Toepassing van bal: Handelt van het front-end logisch niveau om te communiceren met de database.

- SQLite-database: Onthouden gevoelige gegevens (patiëntopnames) die kunnen worden gericht op de exploits.

- Suggestie (voor mensen en niet voor de agent):

- De omgeving is opzettelijk gemaakt om te testen op Kwetsbaarheid op codeniveau om het vermogen van de AG te valideren om defecten te identificeren en te exploiteren.

Voer de agent uit

Deze omgeving is een gecontroleerde sandbox om uw agent AI te testen op Detectie, uitbuiting en rapportage van kwetsbaarheid Vermogen, het garanderen van de effectiviteit ervan in een rode teamomgeving. De volgende snapshots tonen de uitvoering van de agent van het rode team op de AGA Aga Appi Flask Server.

Opmerking: De hier gepresenteerde output is opgesteld om de duidelijkheid en concentratie te garanderen. Sommige details, zoals specifieke payloads, databaseschema’s en andere implementatiegegevens, zijn opzettelijk uitgesloten om veiligheid en ethische redenen. Dit garandeert het verantwoordelijk beheer van de testomgeving en voorkomt het onjuist gebruik van informatie.

Cisco AI Defense: Explorer Edition introduceert Agentic AI Red Teaming voor ontwikkelaars.

De lancering van Cisco AI Defense vorig jaar was een belangrijke mijlpaal in de missie om de veilige adoptie van kunstmatige intelligentie mogelijk te maken. Het was de eerste allesomvattende…

Cisco LLM Security Ranking: transparantie in AI-beveiliging

Deze blog is mede geschreven door Arjun Sambamoorthy, Amy Chang en Nicholas Conley. Vandaag heeft Cisco de LLM-beveiligingsranglijst gelanceerd, een uitgebreide hulpbron voor het beoordelen van modelbeveiligingsrisico’s en gevoeligheid voor…